深度挖掘的公司开始为特定应用定制这种方法,并花费大量资金来获得初创公司。

具有先进并行处理的神经网络已经开始扎根于预测地震和飓风到解析MRI图像数据的许多市场,以便识别和分类肿瘤。

由于这种方法在更多的地方得到实施,所以它是以许多专家从未设想的方式进行定制和解析的。它正在推动对这些计算架构如何应用的新研究。

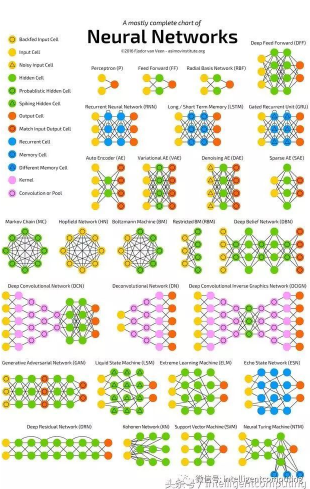

荷兰Asimov研究所的深度学习研究员Fjodor van Veen已经确定了27种不同的神经网络结构类型。 (参见下面的图1)。差异主要是应用程序特定的。

神经网络

图。 1:神经网络架构。资料来源:阿西莫夫研究所

神经网络是基于阈值逻辑算法的概念,这是1943年由神经生理学家Warren McCulloch和逻辑学家Walter Pitts首次提出的。研究在接下来的70年里一直徘徊,但是它真的开始飙升。

Nvidia的加速计算集团产品团队负责人Roy Kim表示:“2012-2013年的大爆炸事件发生在两个里程碑式的出版物上。其中一篇论文是由Geoffrey Hinton和他的团队从多伦多大学(现在也是谷歌的半时间)撰写,题为“ImageNet ClassificaTIon with Deep ConvoluTIonal Neural Networks”。然后在2013年,Stanford的Andrew Ng(现在也是百度首席科学家),他的团队发表了“与COTS HPC系统深度学习”。

Nvidia早期认识到,深层神经网络是人工智能革命的基础,并开始投资于将GPU引入这个世界。 Kim指出卷积神经网络,复发神经网络和长时间内存(LSTM)网络,其中每个网络都设计用于解决特定问题,如图像识别,语音或语言翻译。他指出,Nvidia正在所有这些领域招聘硬件和软件工程师。

6月份,Google大幅增加新闻,Google在神经网络手臂竞赛的半导体领域处于领先地位。 Google卓越的硬件工程师Norm Jouppi公布了公司几年努力的细节,Tensor处理器单元(TPU)是实现硅芯片神经网络组件的ASIC,而不是使用原始硅计算电源和内存库和软件,这也是谷歌也做的。

TPU针对TensorFlow进行了优化,TensorFlow是Google使用数据流图进行数值计算的软件库。它已经在Google数据中心运行了一年多。

不过,这不仅仅是一些正在争夺这一市场的玩家。创业公司Knupath和Nervana进入这个战争,寻求设计具有神经网络的晶体管领域。英特尔上个月向Nervana报了4.08亿美元。

Nervana开发的硅“引擎”是在2017年的某个时候。Nervana暗示了前进的内存缓存,因为它具有8 Tb /秒的内存访问速度。但事实上,Nervana在2014年以种子资本开始投入60万美元,并在两年之后卖出近680倍的投资,这证明了行业和金融家们正在占据的空间 - 以及这个市场有多热。

市场驱动汽车是该技术的核心应用,特别适用于ADAS。 Arteris董事长兼首席执行官Charlie Janac说:“关键是您必须决定图像是什么,并将其转化为卷积神经网络算法。 “有两种方法。一个是GPU。另一种是ASIC,其最终获胜并且使用较少的电力。但一个非常好的实现是紧密耦合的硬件和软件系统。

然而,到紧密耦合系统的这一点,取决于对什么问题需要解决的深刻理解。

LeTI首席执行官Marie Semeria说:“我们必须开发不同的技术选择。 “这是全新的。首先,我们必须考虑使用。这是一种完全不同的驾驶技术方式。这是一个神经性的技术推动。你需要什么?然后,您将根据此开发解决方案。“

该解决方案也可以非常快。 Cadence顾问Chris Rowen表示,其中一些系统每秒可以运行数万亿次 *** 作。但并不是所有这些 *** 作都是完全准确的,而且这个 *** 作也必须被构建到系统中。

Rowen说:“你必须采取一种统计手段来管理正确性。 “你正在使用更高的并行架构。”

最有效的比较这些系统并不容易。在讨论Google TPU时,Jouppi强调了世界各地的研究人员和工程师团队的基本工作方法,以及他们正在使用的硬件和软件的性能:ImageNet。 ImageNet是大学研究人员独立维护的1400万张图像的集合,它允许工程团队将他们的系统找到对象和分类(通常是其子集)的时间缩短。

本月晚些时候,ImageNet大型视觉识别挑战赛(ILSVRC)的结果将于2016年发布,作为在阿姆斯特丹举行的欧洲计算机视觉会议(ECCV)的一部分。

所有在这里讨论的玩家将在那里,包括Nvidia,百度,谷歌和英特尔。高通也将在那里,因为它开始关键的软件库,就像Nvidia一样。 Nvidia将展示其DGX-1深度学习用具和Jetson嵌入式平台,适用于视频分析和机器学习。

ECCV 2016的总裁Arnold Smeulders和Theo Gevers告诉“半导体工程”,ECCV的许多与会者都在半导体技术领域工作(而不是硅片上运行的软件),从而实现计算机视觉。

“最近,半导体技术强国已经开始对计算机视觉感兴趣,”他们通过电子邮件说。 “现在,电脑可以了解图像中存在哪些类型的场景和类型的场景。这需要从注释示例中描述与机器学习匹配的特征中的图像。在过去五年中,这些算法的力量使用深层学习架构大大增加。由于它们是计算密集型产品,包括高通,英特尔,华为和三星在内的芯片制造商,以及苹果,谷歌,亚马逊等大型企业以及许多高科技创业公司也将进入计算机视觉阶段。

Smeulders和Gevers表示,兴趣已经增长到这样的高度,会议场地在一个月前达到最大容量,注册预计将会结束。

以前的ECCV版本长期以来每年大约有100名与会者长大,在苏黎世的上一版本以1,200的成绩结束。 “今年,我们在会议前一个月已经有1500位与会者。在这一点上,我们不得不关闭注册,因为我们雇用的建筑,荷兰皇家剧院,不能更舒适地拥有,“他们写道。

随着行业的复杂和变化,工程经理寻找必要的技能是很困难的。它还引发了电气工程和计算机科学学生关于他们的课程是否会过时的问题,然后才能将它们应用于市场。那么一个学生对电子学有兴趣,特别是半导体在计算机视觉中的作用呢,可以在现场找到工作吗?

Semulders和Gevers表示:“由于图像[识别]是每1/30秒的大量数据,所以半导体行业受到重视是很自然的事情。” “由于大量的数据,直到最近,注意力仅限于处理图像以产生另一个图像(更可见,更清晰的图像中的突出显示元素)或减少图像(目标区域或压缩版本)。这是图像处理领域:图像输入,图像输出。但最近,计算机视觉领域 - 即对图像中可见的解释 - 已经经历了一个非常有成效的时期。他们写道:要了解图像的本质,正在形成的方式和深入网络分析的方式,是现代计算机视觉的关键组成部分。

随机信号处理,机器学习和计算机视觉将是学习和培训的领域。

ECCV的亚洲对手是亚洲CCV。在这几年,国际CCV举行。 Smeulders和Gevers指出,每年夏天在美国举行的计算机视觉和模式识别会议是对CCVs的补充,但是重点略有不同。 Google认为它是所有审查学科的前100名研究来源之一,这是列表中唯一的会议。论文将于11月15日在檀香山举行的7月份e会议上公布。

Nvidia的Kim和其他人认为2012年至2013年将成为在这些神经网络应用中用于计算机视觉等任务的GPU的“大爆炸”。那么下一个大爆炸又是什么?

“自2004年以来,对图像内容进行分类的比赛重新开始,几个算法步骤已经铺平了道路,”Smeulders和Gevers写道。 “一个是SIFT特征[Scale Invariant Feature Transform]。另一种是一些单词和其他编码方案,以及特征定位算法,以及大量图像数据的特征学习。然后,GPU为深入学习网络铺平了道路,进一步提高了性能,因为它们加速了数据集的学习。这意味着需要几周的任务现在可以在一夜之间运行。下一个大爆炸将再次在算法方面。

鉴于投入这笔市场的金额很大,毫无疑问,大事情将会前进。还有多大的待观察,但鉴于这种方法的活动量以及投资的数量,预期是非常高的。

欢迎分享,转载请注明来源:内存溢出

微信扫一扫

微信扫一扫

支付宝扫一扫

支付宝扫一扫

评论列表(0条)