利用人工神经网络在纳秒级时间内完成图像分类,已经成为现实。

近日,奥地利维也纳工业大学光子学研究所 Lukas Mennel 博士等人研发的一种超高速机器视觉设备——自带神经网络的图像传感器,将图像处理速度提升了几十万倍。

上述团队的一篇名为 Ultrafast machine vision with 2D material neural network image sensors(基于二维材料神经网络图像传感器的超快机器视觉)的研究论文发表在《自然》杂志(Nature)上。

了解到,该团队设计的视觉设备如同大脑一样处理信息,40 纳秒即可分辨出两张不同的图像。

可同时获取并分析图像的人工神经网络

视觉是人类认识世界最重要的一个途径,受此启发的「机器视觉」近年来方兴未艾。

所谓机器视觉,就是用机器代替人眼来做测量和判断。但机器视觉并非只是人眼的简单延伸,它还有人脑的一部分功能一一从图像中提取、处理、理解信息,从而用于实际的测量和控制。

就机器视觉技术本身而言,其主要流程是——相机逐行扫描像素,然后将视频帧转换为数字信号,再将其传输到计算机中进行分析。

不过其中存在的问题是,由于传感器与处理单元之间大量数据的移动,信息往往无法得到快速的处理、决策,这也就是机器视觉经常面临的延迟。

考虑到上述因素,研究团队在图像传感器中引入了可同时获取并分析图像的人工神经网络(ArTIficial Neural Network,ANN )。

说到人工神经网络,实际上它是一种运算模型,由大量的节点(也称神经元)相互连接构成。其中,作为核心的神经元接收并处理数据,在图像识别、智能机器人、自动控制、预测估计等领域发挥着重要作用。

具体来讲,人工神经网络可以反复调整神经元之间的连接强度或“突触”,并观察当前的行为模式是否能更好地解决问题,从而发现哪些模式最擅长计算解决方案。接着,人工神经网络会将这些模式设为默认值,模仿人脑学习过程。

实际上,当天《自然》杂志的 News and Views 专栏还发表了香港理工大学博士 Yang Chai 的评论文章 In-sensor compuTIng for machine vision(机器视觉的传感器内计算)。

在其文章中,Yang Chai 博士通过下面这幅图清晰地展现出了两种视觉处理方式的区别:

传统及其视觉处理过程(下图 a 部分):传感器收集信号,通过模数转换器(ADC)将模拟信号转换为数字信号,放大后输入到外部人工神经网络,经参数调优训练神经网络。神经网络输入层接收编码简单物理元素的信号(点、线),随后这些信号优化为中级特征(简单形状),最终在输出层上形成图像(3D 形状);

Lukas Mennel 团队图像传感器处理过程(下图 b 部分):芯片上的互连传感器(图中的正方形)收集信号,并用作人工神经网络识别简单特征,减少传感器和外部电路之间的冗余数据移动。

发光二极管组成的神经网络

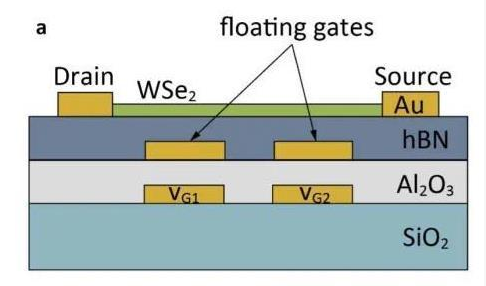

回到研究成果本身,上述传感器实质上是一个光电二极管神经网络,即 9 个像素的正方形阵列,每个像素有 3 个二极管。另外其光敏材料是 2D 半导体二硒化钨(WSe2),这种材料对光具有调节响应能力。

同时,二极管的灵敏度相当于神经网络中的权重,而且其权重直接集成在图像传感器上。

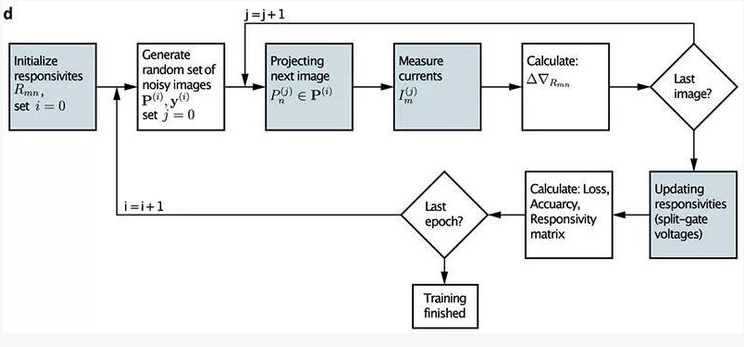

其具体工作流程如下图:当图像被投影到芯片上时,将会产生、组合、读取各种二极管电流。阵列提供了一种模拟计算——每个光电二极管产生与入射光强度成比例的输出电流,并且根据基尔霍夫定律(电路中电流的基本规则)沿着行或列对得到的电流求和。随后阵列便开始进行训练。

据悉,由阵列产生的电流与预测电流(雷锋网注:对于给定的任务,如果阵列正确地响应图像,则将产生所谓的预测电流)之间的差异同时也会得到分析,并将用于调整下一训练周期的突触权重。

两种神经形态功能

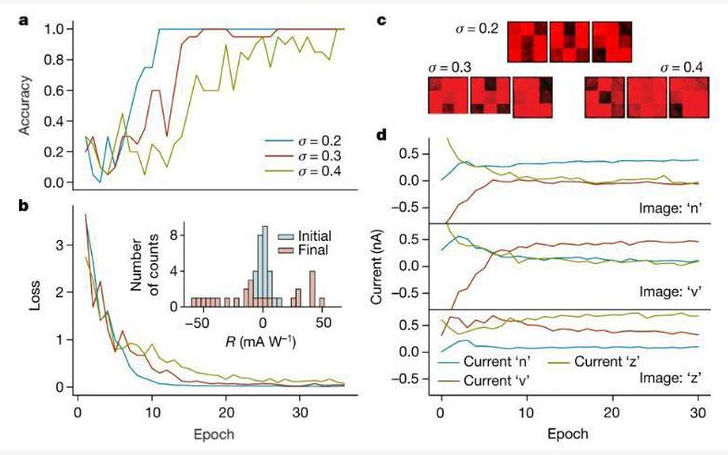

此外,该研究团队根据不同的神经网络算法演示了两种神经形态功能。

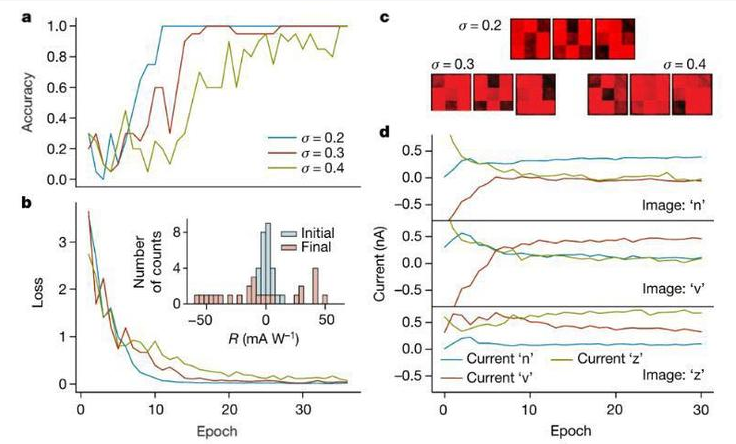

一是「分类」。3×3 像素阵列可以将图像分类为三个字母 n、v、z,经过训练的图像传感器可以在以纳秒为单位的时间内根据“测量对应电路的电流是否为 0”的标准识别字母(下图 d)。据悉,若按比例增加阵列规模,还可以识别更复杂的图像。

二是「自动编码」。即便存在信号噪声,通过学习图像的关键特征,神经网络也能生成处理后图像的简化表示。

不过雷锋网还了解到,该系统有很多局限性,比如:

很难在昏暗的环境下成像;

其设计需要高电压、消耗大量功率;

其所需半导体大面积生产、加工较难;

最大只能处理 3×3 图像。

不过论文作者之一 Lukas Mennel 博士表示:

我们的图像传感器在工作时不会消耗任何电能,被检测的光子本身就可以作为电流供能。传统的机器视觉技术通常能够每秒处理 100 帧图像,而一些更快的系统则可以每秒处理 1000 帧图像,但我们的系统每秒可以处理 2000 万帧图像。

可见,虽然新技术落地都有或多或少的限制,但这一系统在能耗和速度方面确实有着不错的表现,Yang Chai 博士在其文章中也对这一技术给予了肯定:

这一技术并不局限于视觉系统,它可以用于听觉、触觉或嗅觉感测。这种智能系统的发展,以及 5G 高速无线网络的到来,将来会让实时(低延迟)边缘计算成为可能。

欢迎分享,转载请注明来源:内存溢出

微信扫一扫

微信扫一扫

支付宝扫一扫

支付宝扫一扫

评论列表(0条)