虽然苹果和三星都拥有自主开发的应用处理器,锁定了高端智能手机市场,但是联发科(MediaTek)正在寻求在智能手机市场的反d,在本周的2018世界移动通信大会上推出了Helio P60芯片组。下面就随小编一起来了解一下相关内容吧。

联发科的计划是重新进入与高通竞争的中高端智能手机市场。

联发科技将Helio P60视为“首款采用多核AI处理单元(移动APU)和联发科NeuroPilot AI技术的SoC平台”。

联发科的举动显示了该公司在行业智能手机大战中,策略重点转向移动人工智能的巨大变化。目前各种芯片供应商都在竞相将神经网络引擎用于手持设备上。目标很简单。他们希望开启人工智能体验——语音用户界面、人脸解锁、AR等等——在客户端设备上处理更快、更好,无论有没有网络连接。

Linley Group高级分析师Mike Demler表示:“我们在去年才看到了第一批带有嵌入式神经引擎的智能手机处理器,如苹果A11、华为麒麟970、高通Snapdragon 835和联发科Helio X30等旗舰处理器。”

Demler表示:“我们对联发科将在更低层添加神经引擎并不感到意外,但有趣的是,他们正在使用比其旗舰产品X30更强大的核心来实现这一点。”

换句话说,一个由中国手机制造商推动的、充满活力的中端智能手机供应商社区正在跃跃欲试,他们希望尽快赶上移动AI这股趋势。

新高度联发科称其为“新高级”是指“以中档价格提供卓越性能和功能的设备”。联发科销售总经理Finbarr Moynihan解释说,“新高度”是目前智能手机的重要动作,像Oppo、Vivo、联想等中高端玩家都渴望缩小与顶级竞争对手的差距,希望在应用、功能和AI方面取得重大飞跃。

联发科告诉我们,2017年全球智能手机出货量的48%来自中国OEM厂商,主要针对新兴市场。联发科援引TrendForce报告指出,2017年中端消费者品牌出现大幅增长,小米的智能手机产量增幅高达76%,而Transsion、OPPO和Vivo也有大幅增长。

Helio P60在八核CPU中配备了4个ARM A73处理器和4个ARM A53处理器。基于big.LITTLE的8核设计,联发科技宣称与前代产品Helio P23和Hleio P30相比,CPU性能提升了70%。通过使用最高800MHz的新型Mali G72 GPU,P60还将GPU性能提高了70%。

联发科的神经网络引擎然而,让Helio P60实至名归的是其内置的NeuroPilot AI平台、桥接CPU、GPU和板载AI加速。联发科的人工智能框架可以通过协调SoC内CPU、GPU和AI加速计算工作负载来管理异构AI计算架构,最大限度地提高性能和能效。

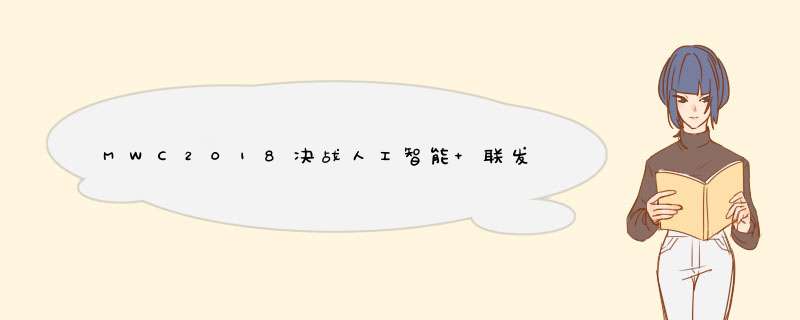

联发科已经证实,P60在其AI加速中集成了Cadence Vision P6内核。

Cadence Vision P6

与联发科技旗舰产品Helio X30——使用Cadence Vision P5,每秒70 GMAC(8位)——相比, Helio P60每秒处理性能为280 GMAC。Demler表示:“所以在处理器整体性能上降低了一层,但同时将神经引擎性能提高了4倍。”

当被问及对比Helio P60神经网络引擎性能时,Demler说:“华为的麒麟970可以达到?1TMAC / s(FP16),因此在更高的分辨率下它的神经网络性能是P60的4倍。在280GMAC / s下,P60与苹果A11的很接近,达到300GMAC / s。”

缺乏AI基准然而,我们咨询的大多数分析师都认为,深度学习加速基准的缺乏,使得很难做出有任何意义的比较。Demler称这是“一个开放的大问题”,他说移动AI这个泥潭可能很容易导致我们陷入“GOPS / TOPS营销炒作之战”。

TIrias Research首席分析师Jim McGregor表示赞同。“这是一个令人困惑的话题,因为没有什么细节和基准。联发科和其他公司使其听起来像是无所不能的人工智能解决方案,”但通常并非如此,McGregor补充说。

例如,联发科的P60中使用的Cadence Vision P6内核是针对计算机视觉应用进行了优化,而非通用神经网络,Demler说。

正如McGregor所解释的,“首先,你需要了解大多数AI处理器是什么。”例如,联发科、苹果和华为称其解决方案为“专用”,意味着使用单个IP块进行AI加速。“在大多数情况下,这意味着从其他方——如Cadence或Ceva——那里获得的IP块许可。这种IP块支持可配置的神经网络,但有一些限制。可是没有人能确切地说出这些限制是什么。”

所以,显然地,在应用处理器内部放置一个神经网络引擎并不是故事的结尾。正如McGregor指出的那样,新神经网络的开发和训练仍然需要在数据中心进行,必须依赖更多高精度、强大的训练处理器。

如果应用开发人员和OEM厂商想要利用智能手机应用处理器内部的神经引擎,他们需要一个与底层硬件挂钩的软件框架。“所有领先的移动处理器设计公司(高通、联发科、华为、苹果)现在都提供神经网络SDK,”Demler观察到。但他们都需要支持像Caffe和Torch这样的流行培训框架。

对联发科来说,联发科提供了被称为NeuroPilot AI SDK的框架,该框架可以让应用开发人员和OEM厂商“深入到硬件,看AI软件如何在CPU、GPU和专用AI加速上运行”,Moynihan这样表示。

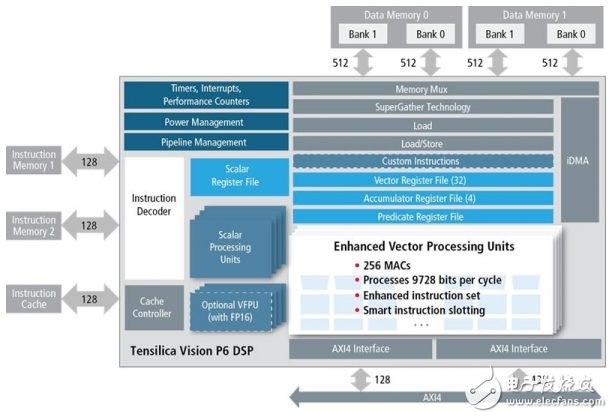

与此同时,应用开发人员和OEM厂商也需要能够“查找并查看Android网络API(Android NNAPI)的内容”,Moynihan补充道。Google为Android机器学习开发了Android NNAPI和运行时引擎。“联发科的NeuroPilot SDK完全符合Android NNAPI,”Moynihan补充道。

Android Neural Networks API的系统架构

在部署能够让智能手机处理器运行AI应用的方法中,高通的方法似乎有些不同。

McGregor说,高通的解决方案是不同的,因为“他们已经在芯片上使用了多种资源,包括Hexagon DSP、Adreno GPU和Kryo CPU内核。”

然而他补充说:“没有可用的基准,不可能确定哪种方法更好,但高通模型确实提供了更高的灵活性。”

AI软件之战无论底层硬件如何,毕竟最关键的还是能够购在任何智能手机上体现AI体验差异化的软件。

McGregor说:“现在,这些应用正瞄准着手机上的常见功能,例如拍照和数字助理。但是,通常由第三方软件开发人员来开发和训练用于手机上的这种模型。”

他指出,“在有限的情况下,有些模型或库是可用的。高通围绕图像识别开发了一些库,三星主要围绕拍照,我相信苹果也正在开发自己的模型。“

在其他情况下,这取决于应用开发人员,这是一个很大的限制,McGregor指出。“很多应用开发人员并不习惯于使用深度学习,也无法访问深度学习所需的大型数据中心,”他说。

Linley Group的Demler在他最近的微处理器报告中也对人工智能软件开发提出了警告。 “处理器架构的多样性给Android应用开发人员带来了挑战,因为即使在缺乏专用深度学习加速的设备上,这些应用也必须能够运行。”而另一方面,iOS应用开发人员只需要支持Apple设计的一些处理器就可以了。

TIrias Research首席分析师Kevin Krewell也警告说:“我看到的最大问题是,每个芯片和IP供应商都在以不同的方式做机器学习。ARM可能有最佳的机会,在一个IP上对多个厂商实施标准化。

以上是关于网络通信中-MWC 2018:人工智能成为主旋律的相关介绍,如果想要了解更多相关信息,请多多关注eeworld,eeworld电子工程将给大家提供更全、更详细、更新的资讯信息。

欢迎分享,转载请注明来源:内存溢出

微信扫一扫

微信扫一扫

支付宝扫一扫

支付宝扫一扫

评论列表(0条)